Prompting JSON pour vidéo IA : Comment Veo 3.1 et Sora 2 remplacent le « Prompt and Pray »

Si vous travaillez dans le marketing à la performance, la production de contenu ou la stratégie créative, vous avez probablement déjà vécu ce scénario :

- Taper un prompt ingénieux dans un outil vidéo IA.

- Cliquer sur Générer.

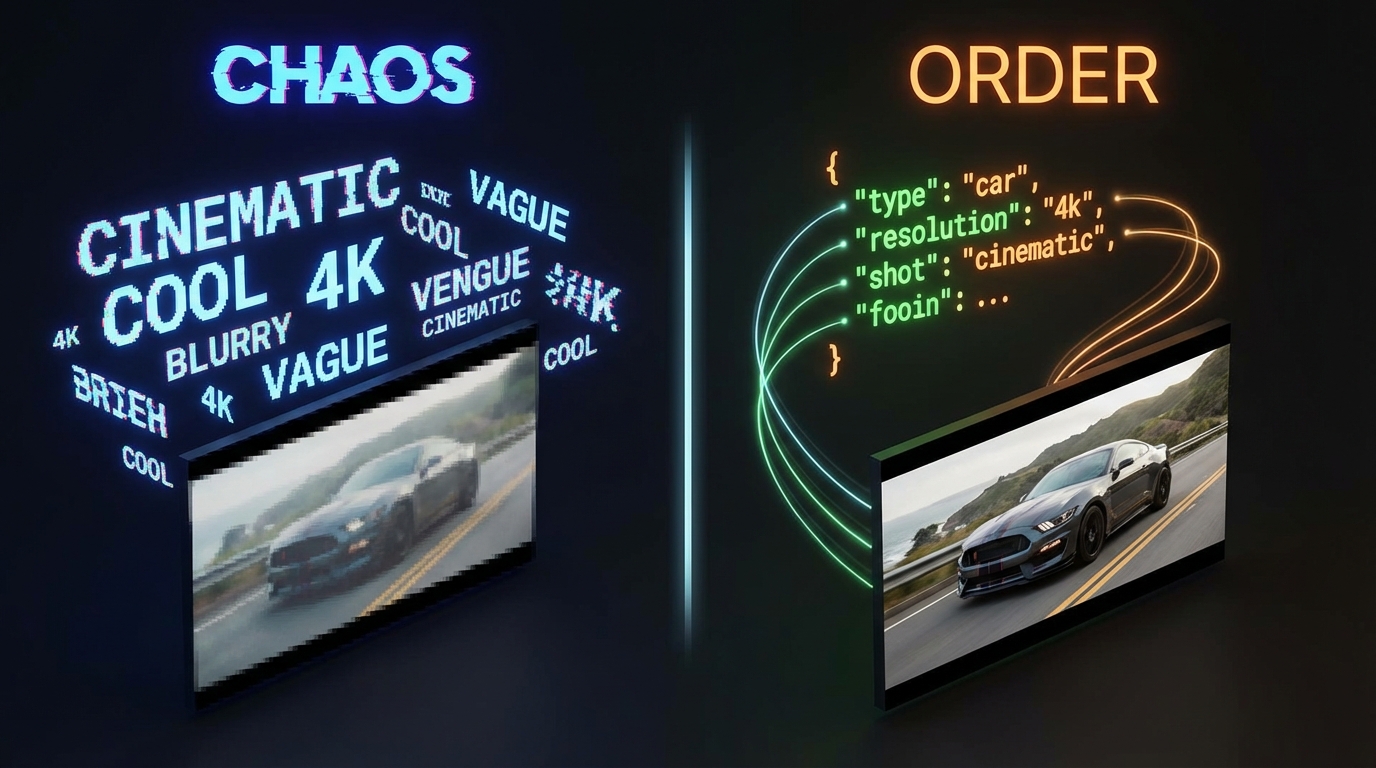

- Croiser les doigts et espérer que « cinématique, 4K, plan produit phare » ne se transforme pas en « chaos flou filmé à la main ».

Les modèles génératifs comme Veo 3.1 et Sora 2 ont rendu la vidéo cinématographique accessible. Mais le flux de travail par défaut reste ce que beaucoup d'équipes appellent discrètement le « prompt and pray » (prompter et prier) — vous balancez un paragraphe de texte et espérez que le modèle devine votre intention.

Ces devinettes conviennent pour des expériences ponctuelles. Mais cela échoue complètement lorsque :

- vous effectuez des tests A/B à grande échelle,

- vous avez besoin d'une cohérence de marque sur des dizaines d'actifs, et

- chaque génération supplémentaire consomme du temps, des crédits et du budget.

C'est là que le prompting JSON change la donne.

Au lieu d'un texte vague, vous définissez des champs structurés — subject (sujet), camera, lighting (éclairage), duration (durée), audio, et même aspectRatio — et vous laissez le modèle suivre un brief clair. JsonToVideo est construit autour de cette idée : des prompts JSON structurés qui produisent des clips prévisibles et conformes à la marque avec Veo 3.1 ou Sora 2.

Pourquoi les prompts IA en texte libre échouent à grande échelle

Un flux de travail vidéo IA standard ressemble à ceci :

« Une voiture de sport futuriste conduisant dans Tokyo la nuit, néons, éclairage cinématique, 4K, plan style produit. »

Le modèle doit deviner tout ce qui suit :

- Quel est exactement le sujet ?

- La caméra est-elle statique, à l'épaule, en travelling ou sur un drone ?

- L'objectif est-il grand angle, normal ou téléobjectif ?

- S'agit-il d'une publicité produit héroïque ou d'une vidéo d'ambiance ?

- L'éclairage est-il sombre, commercial, plat ou stylisé ?

Changez un adjectif, et vous obtenez souvent une vidéo complètement différente. Pour les créateurs de YouTube Shorts, c'est acceptable. Pour les annonceurs avec des objectifs de performance, c'est un cauchemar.

Les points douloureux :

- Vous ne pouvez pas reproduire de manière fiable un plan gagnant.

- Les tests A/B deviennent aléatoires ; vous ne savez pas ce qui a changé.

- Passer de 3 créations à 30 devient un enfer de bricolage manuel de prompts.

Les prompts en forme libre sont bons pour l'exploration. Ils sont terribles en tant que système de production.

Qu'est-ce que le prompting JSON pour la vidéo IA ?

Le prompting JSON traite votre brief vidéo comme des données structurées au lieu d'un paragraphe.

Au lieu de ceci :

« Une voiture de sport rouge dérapant sur un virage de circuit, cinématique, lumière chaude du soleil, pub de 8 secondes, 16:9, musique entraînante. »

Vous passez à quelque chose comme ceci :

{

"subject": "Une voiture de sport rouge dérapant dans un virage de circuit",

"camera": "Plan travelling en contre-plongée suivant la voiture par derrière",

"lighting": "Golden hour, lumière chaude du soleil, longues ombres",

"style": "Cinématique, net, contraste élevé",

"durationSeconds": 8,

"aspectRatio": "16:9",

"audio": "Piste électronique énergique avec bruits de moteur"

}

Désormais, le modèle n'a plus à deviner :

- Subject = ce qui est à l'écran.

- Camera = comment le spectateur en fait l'expérience.

- Lighting & style = le ton émotionnel.

- Duration & aspect ratio = contraintes de format.

Des plateformes comme JsonToVideo vont plus loin : elles enveloppent les prompts JSON dans un éditeur visuel, des modèles réutilisables et une configuration à double modèle (Veo 3.1 et Sora 2) qui partagent tous le même schéma.

Champs JSON principaux pour Veo 3.1 et Sora 2

Bien que chaque équipe finisse par avoir son propre schéma, la plupart des configurations performantes partagent quelques champs essentiels :

1. subject : Qui ou quoi filmons-nous réellement ?

C'est votre héros :

- un produit sur une table,

- un athlète qui court,

- une ligne d'horizon de ville,

- une personne parlant face caméra.

En isolant le sujet, vous gardez l'identité et la géométrie stables pendant que vous itérez sur la caméra, l'éclairage et le style.

2. camera : Comment voyons-nous le sujet ?

Les prompts textuels enterrent souvent la direction de la caméra comme une arrière-pensée. Le prompting JSON vous force à l'expliciter :

camera: "Plan d'ensemble par drone, lent travelling avant au-dessus de la ville"camera: "Caméra à l'épaule, à hauteur des yeux, léger mouvement latéral"camera: "Gros plan macro, faible profondeur de champ, travelling lent sur le produit"

Veo 3.1, en particulier, réagit fortement au langage explicite de la caméra — considérez cela comme le champ de cinématographie dans votre schéma.

3. lighting & style : Ambiance, genre et finition

L'éclairage et le style méritent leurs propres champs car ils changent l'émotion sans briser le contenu :

lighting: "Lumière du jour douce, studio propre, ombres minimales"lighting: "Néons cyberpunk, forts éclairages de contour (rim lights), fond sombre"style: "Pub e-commerce léchée, contraste élevé"style: "Vidéo verticale style UGC, lumière naturelle, léger grain"

Vous pouvez exécuter des dizaines de combinaisons d'éclairage/style sur le même sujet + caméra pour voir ce qui convertit le mieux.

4. durationSeconds & aspectRatio : Adaptation à la plateforme

Vous connaissez le problème : une pub YouTube en 16:9 a l'air horrible lorsqu'elle est recadrée en 9:16 pour TikTok.

Le JSON vous permet d'encoder la durée et le cadre :

durationSeconds: 8 ou 12aspectRatio: "16:9", "9:16", ou "1:1"

Le moteur de JsonToVideo utilise ces champs pour cibler YouTube, TikTok, les Reels ou les placements dans le flux à partir du même modèle, et non pas un énième prompt.

5. audio et contraintes de marque

Enfin, vous pouvez verrouiller le son et la marque :

audio: "Beat trap énergique, 100 BPM, pas de voix"audio: "Nappe ambiante calme, montées subtiles"brandLock.logoPlacement: "bottom-right"(en bas à droite)brandLock.colorPalette: "rouge, noir, blanc"

C'est la différence entre une « démo sympa » et une publicité diffusable.

Étape par étape : Votre premier prompt JSON Veo 3.1 (Publicité produit, 16:9)

Transformons cela en quelque chose que vous pouvez réellement copier.

1. Commencez par un schéma simple

Voici un modèle minimal pour une publicité produit Veo 3.1 :

{

"model": "veo-3.1",

"aspectRatio": "16:9",

"durationSeconds": 8,

"subject": "",

"camera": "",

"lighting": "",

"style": "",

"audio": "",

"brandLock": {

"logoPlacement": "bottom-right",

"colorPalette": ""

}

}

2. Remplissez-le pour un scénario concret

Disons maintenant que vous faites la promotion d'écouteurs sans fil :

{

"model": "veo-3.1",

"aspectRatio": "16:9",

"durationSeconds": 8,

"subject": "Une paire d'écouteurs sans fil noir mat sur une surface en verre réfléchissante",

"camera": "Lent travelling avant (dolly-in) d'un plan moyen vers un gros plan, léger effet de parallaxe autour du produit",

"lighting": "Studio sombre avec des lumières de contour blanches nettes et des reflets subtils",

"style": "Publicité technologique premium, net, contraste élevé, prêt pour 1080p",

"audio": "Piste électronique moderne avec des basses profondes synchronisées aux transitions",

"brandLock": {

"logoPlacement": "bottom-right",

"colorPalette": "noir, blanc, bleu électrique"

}

}

3. Exécutez-le via JsonToVideo

Dans JsonToVideo :

- Ouvrez l'éditeur de Prompt JSON.

- Collez le modèle et ajustez

brandLocketstylepour correspondre à votre marque. - Sélectionnez Veo 3.1 comme modèle et générez.

Vous avez maintenant une recette répétable et modifiable au lieu d'un prompt fragile à usage unique.

Exemple 2 : Publicité sociale style UGC vertical (Sora 2, 9:16)

Adaptons maintenant l'idée pour un clip TikTok ou Reels de style UGC utilisant Sora 2.

{

"model": "sora-2",

"aspectRatio": "9:16",

"durationSeconds": 10,

"subject": "Une jeune femme enregistrant une vidéo selfie parlant de son nouveau sérum pour la peau dans une salle de bain confortable",

"camera": "À l'épaule, hauteur des yeux, léger tremblement naturel, micro-recadrages occasionnels",

"lighting": "Éclairage intérieur chaud du miroir de la salle de bain, ombres douces, tons de peau naturels",

"style": "Publicité verticale UGC, sensation d'un vrai clip de téléphone, léger grain",

"audio": "Voix off naturelle avec musique de fond subtile à faible volume",

"callToAction": "Texte à l'écran : 'Essayez-le pendant 30 jours' apparaissant vers la fin"

}

C'est toujours structuré, mais intentionnellement moins poli qu'un spot produit Veo 3.1. Vous dites à Sora 2 :

- Fais en sorte que cela ressemble au selfie d'une vraie personne,

- Garde le mouvement honnête et légèrement tremblant,

- Mets le CTA (appel à l'action) à l'écran, pas comme une arrière-pensée aléatoire.

Exemple 3 : Mouvement Image-vers-Vidéo JSON à partir d'une photo produit

JsonToVideo prend également en charge la conversion image-vidéo, où vous téléchargez une image fixe et ajoutez du JSON pour contrôler le mouvement.

Imaginez que vous ayez déjà une photo produit forte et que vous souhaitiez un mouvement héroïque simple :

{

"mode": "image-to-video",

"imageUrl": "https://your-cdn.com/images/serum-bottle.png",

"model": "veo-3.1",

"durationSeconds": 10,

"aspectRatio": "9:16",

"cameraPath": "Commencer par un plan moyen de la bouteille, puis lent travelling avant et petit arc dans le sens horaire autour du produit",

"motionIntensity": "medium",

"pacing": "stable, pas de sauts brusques",

"lighting": "Lumière de studio propre, fond blanc, reflets doux sur le verre",

"style": "Publicité e-commerce minimaliste, accent sur la clarté et la lisibilité de l'étiquette",

"audio": "Nappe de fond ambiante douce, pas de voix"

}

Cela correspond à la façon dont la fonctionnalité Image vers Vidéo de JsonToVideo décrit la « Photo en Mouvement en une étape » et les « Contrôles de mouvement JSON » : vous fournissez une image, sélectionnez Veo 3.1 ou Sora 2, et utilisez le JSON pour diriger le chemin de la caméra et le rythme au lieu d'espérer que le modèle choisisse un bon panoramique ou zoom.

Des clips uniques à la création programmatique

La véritable puissance du prompting JSON n'est pas qu'un seul prompt soit légèrement meilleur. C'est que :

- Vous pouvez stocker les prompts comme modèles,

- Échanger quelques champs (

subject,colorPalette,callToAction), et - Générer des dizaines ou des centaines de variations par programmation.

Par exemple :

Gardez camera, lighting, style, durationSeconds, et aspectRatio fixes.

Itérez sur une feuille de calcul de produits :

subject: "Chaussure de course rouge sur sol en béton"subject: "Chaussure de trail noire sur chemin rocheux"subject: "Sneaker lifestyle blanche sur bureau en bois"

Ou changez juste le callToAction pour des tests A/B :

- "Livraison gratuite aujourd'hui"

- "Essayez-le pendant 30 jours"

- "Pack & économisez 20%"

C'est ce pour quoi JsonToVideo est conçu : transformer des données structurées en clips cinématographiques sans avoir à re-prompter manuellement pour chaque version.

Pourquoi les annonceurs s'y intéressent : Qualité, Droits et Format

Les outils gratuits et les démos ponctuelles sont très bien pour les loisirs. Pour les vraies campagnes, les équipes se soucient de :

- La résolution qui tient la route dans les pubs – JsonToVideo est construit autour de sorties de qualité 1080p qui sont nettes sur les écrans modernes.

- Pas de filigranes – c'est votre marque, et non l'outil, qui doit posséder le cadre.

- Droits d'utilisation commerciale – pour que votre équipe juridique ne fasse pas une crise de panique.

- Ratios d'aspect multiples – 16:9 pour les landing pages, 9:16 pour TikTok/Reels, le tout à partir du même modèle.

- Coûts prévisibles – une tarification basée sur des crédits qui correspond clairement aux volumes de rendus Veo 3.1 et Sora 2.

Le prompting JSON ne se contente pas de rendre les vidéos plus belles — il rend tout le pipeline mesurable et répétable.

Comment JsonToVideo s'intègre dans votre stack

JsonToVideo est conçu spécifiquement pour les équipes qui veulent traiter les prompts comme du code :

- Prompts JSON structurés pour Veo 3.1 et Sora 2

- Bibliothèque de modèles pour des plans et campagnes réutilisables

- Image-to-video avec contrôles de mouvement JSON lorsque vous avez déjà des photos fortes

- Tarification basée sur des crédits qui s'adapte des créateurs solos aux agences et équipes internes

Vous pouvez commencer visuellement et laisser l'éditeur générer le JSON pour vous, ou passer directement au JSON brut si vous êtes déjà à l'aise avec.

Prochaines étapes : Arrêtez de deviner, commencez à réaliser

Si vous écrivez encore des prompts d'une ligne en espérant le meilleur, vous laissez de l'argent — et votre santé mentale — sur la table.

Voici comment transformer cet article en un véritable flux de travail :

- Ouvrez l'éditeur de Prompt JSON : Partez d'un préréglage, puis ajoutez

subject,camera,lighting,durationSeconds, etaspectRatio. - Collez l'un des modèles ci-dessus : Personnalisez

subject,brandLock, etcallToActionpour votre produit. - Testez Veo 3.1 vs Sora 2 : Utilisez Sora 2 pour l'exploration créative rapide, puis verrouillez les concepts gagnants dans Veo 3.1 pour des exécutions de qualité production.

- Passez à l'échelle avec les données : Une fois que vous avez un modèle JSON qui convertit, connectez-le à une feuille de calcul ou un CMS et générez à grande échelle.

Vous n'avez pas à abandonner la créativité. Il vous suffit d'arrêter de prier et de commencer à réaliser.

Table des matières

Auteur

Catégories

Newsletter

Rejoignez la communauté

Abonnez-vous pour recevoir les dernières actualités et modèles